La poca sicurezza informatica nei laboratori di intelligenza artificiale

La creatrice della nota intelligenza artificiale ChatGPT ha subito un attacco informatico nel 2023, ma la notizia è emersa solo oggi. Secondo il New York Times, i cracker (non hacker, che agiscono con etica e morale per migliorare i sistemi) non sono riusciti a penetrare nei laboratori più protetti dove si sviluppano queste forme embrionali di intelligenza artificiale.

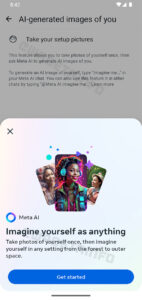

Recentemente, alcuni cracker hanno rilasciato una versione modificata di ChatGPT, chiamata “God Mod GPT“, che permette di chiedere qualsiasi cosa al chatbot, incluso come realizzare droghe e armi, sfruttando un “jailbreak” del codice del modello.

A mio modestissimo parere siamo messi molto male con sistemi informatici ormai presenti ovunque e con pochissima, reale attenzione al tema della sicurezza informatica. Ci stiamo affidando a dei bambini che giocano a fare gli adulti se non fosse poi che le intelligenze artificiali, generative si stanno diffondendo ovunque, in ogni settore dello scibile umano in modo pervasivo.